作者:JacobZhao 来源:mirror

一、引言 | Crypto AI 的模型层跃迁

数据、模型与算力是 AI 基础设施的三大核心要素,类比燃料(数据)、引擎(模型)、能源(算力)缺一不可。与传统 AI 行业的基础设施演进路径类似,Crypto AI 领域也经历了相似的阶段。2024 年初,市场一度被去中心化 GPU 项目所主导 (Akash、Render、io.net 等 ),普遍强调「拼算力」的粗放式增长逻辑。而进入 2025 年后,行业关注点逐步上移至模型与数据层,标志着 Crypto AI 正从底层资源竞争过渡到更具可持续性与应用价值的中层构建。

通用大模型(LLM)vs 特化模型(SLM)

传统的大型语言模型(LLM)训练高度依赖大规模数据集与复杂的分布式架构,参数规模动辄 70B~500B,训练一次的成本常高达数百万美元。而 SLM(Specialized Language Model)作为一种可复用基础模型的轻量微调范式,通常基于 LLaMA、Mistral、DeepSeek 等开源模型,结合少量高质量专业数据及 LoRA 等技术,快速构建具备特定领域知识的专家模型,显著降低训练成本与技术门槛。

值得注意的是,SLM 并不会被集成进 LLM 权重中,而是通过 Agent 架构调用、插件系统动态路由、LoRA 模块热插拔、RAG(检索增强生成)等方式与 LLM 协作运行。这一架构既保留了 LLM 的广覆盖能力,又通过精调模块增强了专业表现,形成了高度灵活的组合式智能系统。

Crypto AI 在模型层的价值与边界

Crypto AI 项目本质上难以直接提升大语言模型(LLM)的核心能力,核心原因在于

技术门槛过高:训练 Foundation Model 所需的数据规模、算力资源与工程能力极其庞大,目前仅有美国(OpenAI 等)与中国(DeepSeek 等)等科技巨头具备相应能力。

开源生态局限:虽然主流基础模型如 LLaMA、Mixtral 已开源,但真正推动模型突破的关键依然集中于科研机构与闭源工程体系,链上项目在核心模型层的参与空间有限。

然而,在开源基础模型之上,Crypto AI 项目仍可通过精调特化语言模型(SLM),并结合 Web3 的可验证性与激励机制实现价值延伸。作为 AI 产业链的「周边接口层」,体现于两个核心方向:

可信验证层:通过链上记录模型生成路径、数据贡献与使用情况,增强 AI 输出的可追溯性与抗篡改能力。

激励机制: 借助原生 Token,用于激励数据上传、模型调用、智能体(Agent)执行等行为,构建模型训练与服务的正向循环。

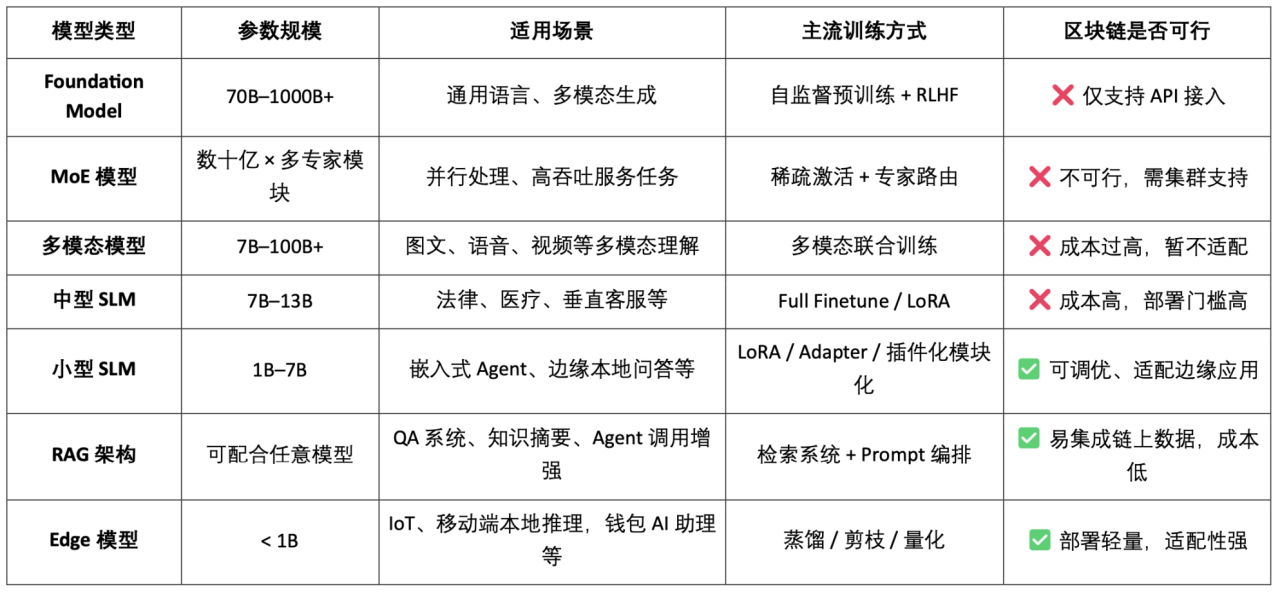

AI 模型类型分类与 区块链适用性分析

由此可见,模型类 Crypto AI 项目的可行落点主要集中在小型 SLM 的轻量化精调、RAG 架构的链上数据接入与验证、以及 Edge 模型的本地部署与激励上。结合区块链的可验证性与代币机制,Crypto 能为这些中低资源模型场景提供特有价值,形成 AI「接口层」的差异化价值。

基于数据与模型的区块链 AI 链,可对每一条数据和模型的贡献来源进行清晰、不可篡改的上链记录,显著提升数据可信度与模型训练的可溯性。同时,通过智能合约机制,在数据或模型被调用时自动触发奖励分发,将 AI 行为转化为可计量、可交易的代币化价值,构建可持续的激励体系。此外,社区用户还可通过代币投票评估模型性能、参与规则制定与迭代,完善去中心化治理架构。

二、项目概述 | OpenLedger 的 AI 链愿景

OpenLedger 是当前市场上为数不多专注于数据与模型激励机制的区块链 AI 项目。它率先提出「Payable AI」的概念,旨在构建一个公平、透明且可组合的 AI 运行环境,激励数据贡献者、模型开发者与 AI 应用构建者在同一平台协作,并根据实际贡献获得链上收益。

OpenLedger 提供了从「数据提供」到「模型部署」再到「调用分润」的全链条闭环,其核心模块包括:

Model Factory:无需编程,即可基于开源 LLM 使用 LoRA 微调训练并部署定制模型;

OpenLoRA:支持千模型共存,按需动态加载,显著降低部署成本;

PoA(Proof of Attribution):通过链上调用记录实现贡献度量与奖励分配;

Datanets:面向垂类场景的结构化数据网络,由社区协作建设与验证;

模型提案平台(Model Proposal Platform):可组合、可调用、可支付的链上模型市场。

通过以上模块,OpenLedger 构建了一个数据驱动、模型可组合的「智能体经济基础设施」,推动 AI 价值链的链上化。

而在区块链技术采用上,OpenLedger 以 OP Stack EigenDA 为底座,为 AI 模型构建了高性能、低成本、可验证的数据与合约运行环境。

基于 OP Stack 构建: 基于 Optimism 技术栈,支持高吞吐与低费用执行;

在以太坊主网上结算: 确保交易安全性与资产完整性;

EVM 兼容: 方便开发者基于 Solidity 快速部署与扩展;

EigenDA 提供数据可用性支持:显著降低存储成本,保障数据可验证性。

相比于 NEAR 这类更偏底层、主打数据主权与 「AI Agents on BOS」 架构的通用型 AI 链,OpenLedger 更专注于构建面向数据与模型激励的 AI 专用链,致力于让模型的开发与调用在链上实现可追溯、可组合与可持续的价值闭环。它是 Web3 世界中的模型激励基础设施,结合 HuggingFace 式的模型托管、Stripe 式的使用计费与 Infura 式的链上可组合接口,推动「模型即资产」的实现路径。

三、OpenLedger 的核心组件与技术架构

3.1 Model Factory,无需代码模型工厂

ModelFactory 是 OpenLedger 生态下的一个大型语言模型(LLM)微调平台。与传统微调框架不同,ModelFactory 提供纯图形化界面操作,无需命令行工具或 API 集成。用户可以基于在 OpenLedger 上完成授权与审核的数据集,对模型进行微调。实现了数据授权、模型训练与部署的一体化工作流,其核心流程包括:

数据访问控制: 用户提交数据请求,提供者审核批准,数据自动接入模型训练界面。

模型选择与配置: 支持主流 LLM(如 LLaMA、Mistral),通过 GUI 配置超参数。

轻量化微调: 内置 LoRA / QLoRA 引擎,实时展示训练进度。

模型评估与部署: 内建评估工具,支持导出部署或生态共享调用。

交互验证接口: 提供聊天式界面,便于直接测试模型问答能力。

RAG 生成溯源: 回答带来源引用,增强信任与可审计性。

Model Factory 系统架构包含六大模块,贯穿身份认证、数据权限、模型微调、评估部署与 RAG 溯源,打造安全可控、实时交互、可持续变现的一体化模型服务平台。

ModelFactory 目前支持的大语言模型能力简表如下:

LLaMA 系列:生态最广、社区活跃、通用性能强,是当前最主流的开源基础模型之一。

Mistral:架构高效、推理性能极佳,适合部署灵活、资源有限的场景。

Qwen:阿里出品,中文任务表现优异,综合能力强,适合国内开发者首选。

ChatGLM:中文对话效果突出,适合垂类客服和本地化场景。

Deepseek:在代码生成和数学推理上表现优越,适用于智能开发辅助工具。

Gemma:Google 推出的轻量模型,结构清晰,易于快速上手与实验。

Falcon:曾是性能标杆,适合基础研究或对比测试,但社区活跃度已减。

BLOOM:多语言支持较强,但推理性能偏弱,适合语言覆盖型研究。

GPT-2:经典早期模型,仅适合教学和验证用途,不建议实际部署使用。

虽然 OpenLedger 的模型组合并未包含最新的高性能 MoE 模型或多模态模型,但其策略并不落伍,而是基于链上部署的现实约束(推理成本、RAG 适配、LoRA 兼容、EVM 环境)所做出的「实用优先」配置。

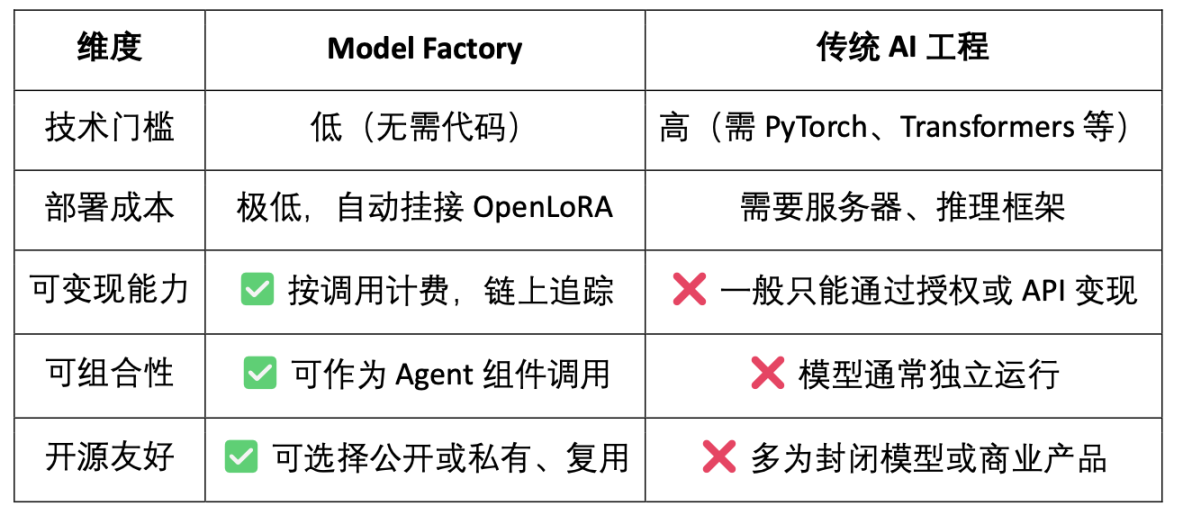

Model Factory 作为无代码工具链,所有模型都内置了贡献证明机制,确保数据贡献者和模型开发者的权益,具有低门槛、可变现与可组合性的优点,与传统模型开发工具相比较:

对于开发者:提供模型孵化、分发、收入的完整路径;

对于平台:形成模型资产流通与组合生态;

对于应用者:可以像调用 API 一样组合使用模型或 Agent。

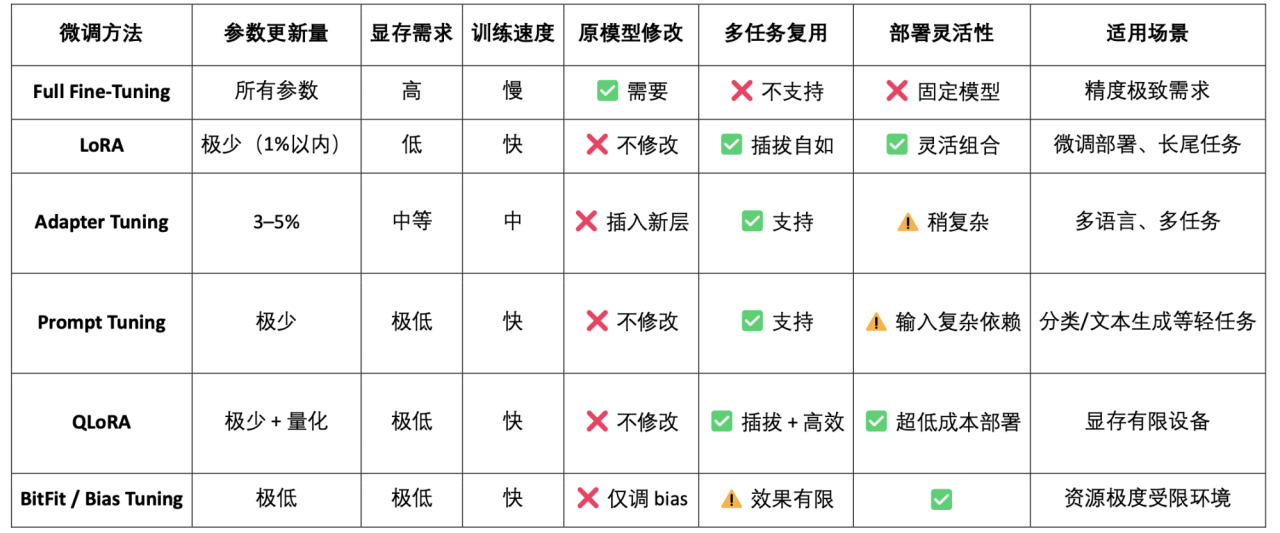

3.2 OpenLoRA,微调模型的链上资产化

LoRA(Low-Rank Adaptation)是一种高效的参数微调方法,通过在预训练大模型中插入「低秩矩阵」来学习新任务,而不修改原模型参数,从而大幅降低训练成本和存储需求。传统大语言模型(如 LLaMA、GPT-3)通常拥有数十亿甚至千亿参数。要将它们用于特定任务(如法律问答、医疗问诊),就需要进行微调(fine-tuning)。LoRA 的核心策略是:「冻结原始大模型的参数,只训练插入的新参数矩阵。」,其参数高效、训练快速、部署灵活,是当前最适合 Web3 模型部署与组合调用的主流微调方法。

OpenLoRA 是 OpenLedger 构建的一套专为多模型部署与资源共享而设计的轻量级推理框架。它核心目标是解决当前 AI 模型部署中常见的高成本、低复用、GPU 资源浪费等问题,推动「可支付 AI」(Payable AI)的落地执行。

OpenLoRA 系统架构核心组件,基于模块化设计,覆盖模型存储、推理执行、请求路由等关键环节,实现高效、低成本的多模型部署与调用能力:

LoRA Adapter 存储模块 (LoRA Adapters Storage):微调后的 LoRA adapter 被托管在 OpenLedger 上,实现按需加载,避免将所有模型预载入显存,节省资源。

模型托管与动态融合层 (Model Hosting

-

免费下载或者VIP会员资源能否直接商用?本站所有资源版权均属于原作者所有,这里所提供资源均只能用于参考学习用,请勿直接商用。若由于商用引起版权纠纷,一切责任均由使用者承担。更多说明请参考 VIP介绍。

-

提示下载完但解压或打开不了?最常见的情况是下载不完整: 可对比下载完压缩包的与网盘上的容量,若小于网盘提示的容量则是这个原因。这是浏览器下载的bug,建议用百度网盘软件或迅雷下载。 若排除这种情况,可在对应资源底部留言,或联络我们。

-

找不到素材资源介绍文章里的示例图片?对于会员专享、整站源码、程序插件、网站模板、网页模版等类型的素材,文章内用于介绍的图片通常并不包含在对应可供下载素材包内。这些相关商业图片需另外购买,且本站不负责(也没有办法)找到出处。 同样地一些字体文件也是这种情况,但部分素材会在素材包内有一份字体下载链接清单。

-

付款后无法显示下载地址或者无法查看内容?如果您已经成功付款但是网站没有弹出成功提示,请联系站长提供付款信息为您处理

-

购买该资源后,可以退款吗?源码素材属于虚拟商品,具有可复制性,可传播性,一旦授予,不接受任何形式的退款、换货要求。请您在购买获取之前确认好 是您所需要的资源

评论(0)